今天就来和大家说一下如何在本地运行最牛逼的开源大模型deepseek-r1。我们需要使用到的工具是ollama。

1、下载安装ollama

唯一官网:https://ollama.com/

根据自己的电脑选择Windows和Macos都支持下载ollama。我这里选择下载Windwos版本的。下载完后一步步进行安装等待安装完成。

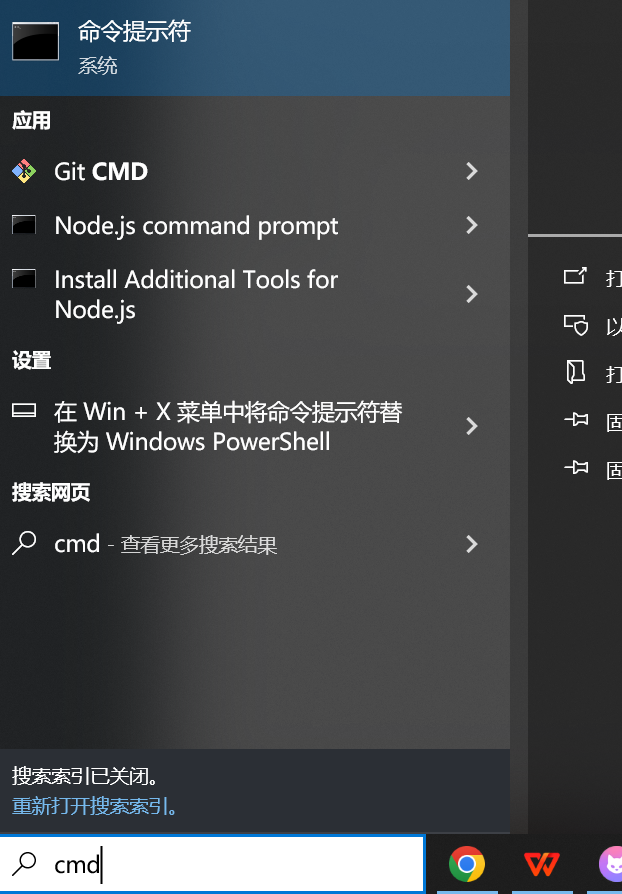

2、打开终端运行ollama。

Windows在运行输入cmd。macos的用户可以打开终端工具。

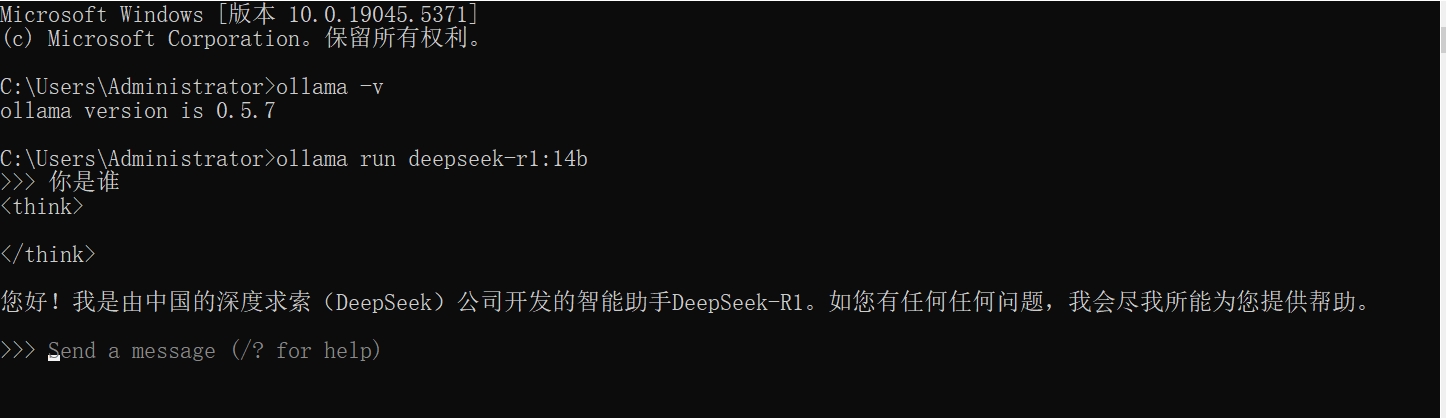

输入命令 ollama -v 如果显示版本信息,代表现在ollama已经成功安装了。

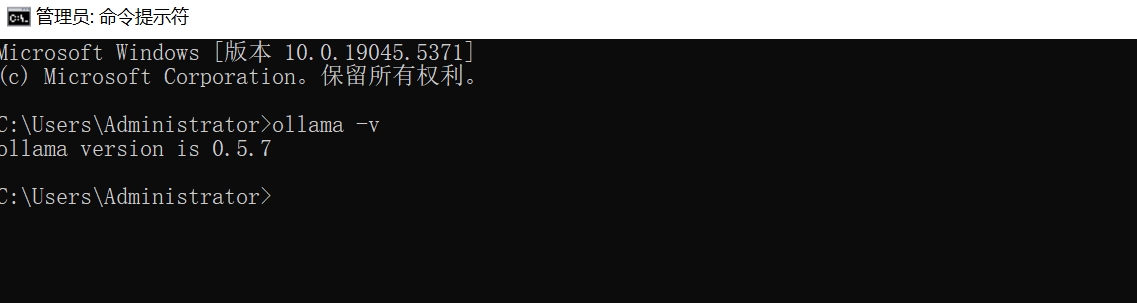

3、下载deepseek-r1模型

deepseek-r1模型下载地址:https://ollama.com/library/deepseek-r1

deepseek-r1开源有很多个版本。大家可以根据自己的GPU显存来进行选择。一般我们本地下载7b或者14b就可以满足大部分的需求了。我这里下载deepseek-r1:14b的版本。

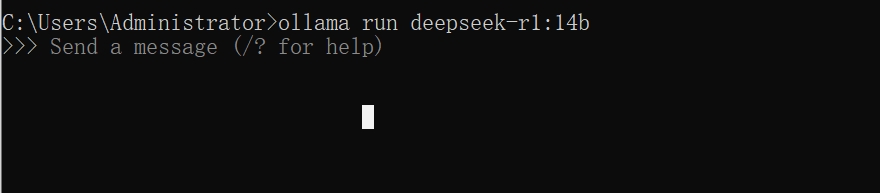

选择完要下载的版本,旁边会显示一个ollama的下载命令。这个时候我们复制这个命令在终端打开。等待模型下载成功后会提示Send a message。这个时候模型已经下载完毕,我们就可以直接使用命令终端进行对话了。

这个时候你就算断网了也能本地使用deepseek大模型来完成日常的任务处理。

如果你需要结束退出模型对话就在终端输入 /bye 这个时候就可以退出模型对话。

4、如何二次进入本地deepseek-r1大模型

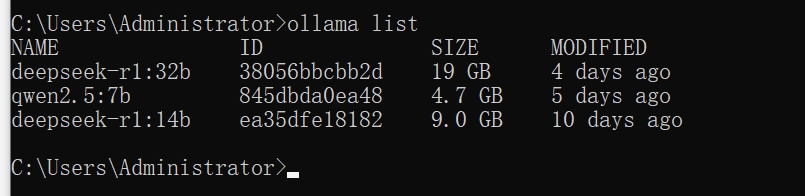

当我们退出本次对话想要下次再使用deepseek大模型的时候。首先还是打开cmd或者终端工具。然后我们可以输入ollama list 查看本地下载的模型列表。根据自己的需求运行相应的模型。

输入 ollama run 模型名称(NAME) 就可以直接进入模型对话了。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...